statworx auf der Big Data & AI World

Von Medien über Politik bis hin zu großen und kleinen Unternehmen – Künstliche Intelligenz hat im Jahr 2023 endlich den Sprung in den Mainstream geschafft. Umso mehr haben wir uns gefreut, dieses Jahr wieder auf einer der größten KI-Messen im DACH-Raum, der „Big Data & AI World“, in unserer Heimatstadt Frankfurt vertreten zu sein. Bei dieser Veranstaltung standen die Themen Big Data und künstliche Intelligenz im Mittelpunkt; ein perfektes Umfeld für uns als KI-Spezialist:innen. Doch wir kamen nicht nur zum Erkunden der Messe und zum Knüpfen von Kontakten: Auch an unserem eigenen Stand konnten Besucher:innen ein faszinierendes Pac-Man-Spiel mit einem besonderen Kniff erleben. In diesem Beitrag möchten wir Ihnen gerne einen Rückblick auf diese aufregende Messe geben.

Abb. 1: unser Messestand

KI zum Anfassen

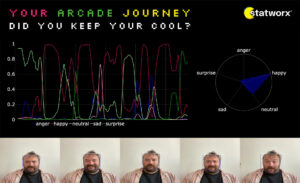

Unsere Pac-Man Challenge, bei der wir den Standbesucher:innen die faszinierende Welt der künstlichen Intelligenz hautnah präsentierten, stellte sich als wahrer Publikumsliebling heraus. Mit unserem Spielautomaten konnte man sich nicht nur an dem zeitlosen Retro-Spiel versuchen, sondern auch die beeindruckende Leistungsfähigkeit moderner KI-Technologie erleben. So setzten wir nämlich eine KI ein, um die Emotionen in der Mimik der Spieler:innen in Echtzeit zu analysieren. Diese Kombination von modernster Technologie mit einem interaktiven Spielerlebnis kam hervorragend an.

Unsere KI-Lösung zur lief auf einem MacBook mit leistungsstarkem M1-Chip, was die Bildverarbeitung in Echtzeit und flüssige Grafikdarstellung ermöglichte. Die Gesichtserkennung der Spieler:innen wurde durch einen smarten Algorithmus ermöglicht, der sofort alle Gesichter im Video ermittelte. Anschließend wurde das Gesicht, das sich am nächsten an der Kamera befand, ausgewählt und fokussiert. So konnte auch bei einer langen Schlange vor dem Automaten das korrekte Gesicht analysiert werden. Eine weitere Schicht der Verarbeitung erfolgte durch ein Convolutional Neural Network (CNN), speziell das ResNet18-Modell, welches die Emotionen der Spieler:innen erkannte.

Unser Backend fungierte als Multimedia-Server, der den Webcam-Stream, die Gesichtserkennungsalgorithmen und die Emotionserkennung verarbeitete. Es kann sowohl vor Ort auf einem MacBook betrieben werden wie auch remote in der Cloud. Dank dieser Flexibilität konnten wir ein ansprechendes Frontend entwickeln, um die Ergebnisse der Echtzeitanalyse anschaulich darzustellen. Zusätzlich wurden nach jedem Spiel die Resultate mittels E-Mail an die Spieler:innen versandt, indem wir das Modell mit unserem CRM-System verknüpft haben. Für die E-Mail haben wir eine digitale Postkarte erstellt, welche neben Screenshots der intensivsten Emotionen auch eine umfassende Auswertung bereitstellt.

Abb. 2: Besucherin am Pac-Man Spieleautomaten

Künstliche Intelligenz, echte Emotionen

Die Pac-Man Challenge mit Emotionsanalyse sorgte bei den Messebesucher:innen für Begeisterung. Neben der besonderen Spielerfahrung auf unserem Retro-Automaten erhielten die Teilnehmenden nämlich auch einen Einblick in ihre eigenen Emotionen während des Spielens. So konnten die Spieler:innen detailliert ablesen, welche Emotion zu welchem Zeitpunkt im Spiel am präsentesten war. Allzu oft ließ sich ein kleines Aufkommen von Wut oder Traurigkeit messen, wenn Pac-Man unfreiwillig in den digitalen Tod geschickt wurde.

Nicht alle Spieler:innen zeigten jedoch die gleiche Reaktion auf das Spiel. Während manche ein Wechselbad der Gefühle zu erleben schienen, setzten andere ein eisernes Pokerface auf, dem selbst die KI nur einen neutralen Ausdruck entlocken konnte. Somit entstanden viele spannende Gespräche darüber, wie die gemessenen Emotionen zum Erlebnis der Spieler:innen passten. Es bedurfte keiner KI, um zu erkennen, dass die Besucher:innen unseren Stand mit positiven Emotionen verließen – nicht zuletzt in Hoffnung auf den Gewinn der originalen NES-Konsole, die wir unter allen Teilnehmenden verlosten.

Abb. 3: digitale Postkarte

Die KI-Community im Aufbruch

Die „Big Data & AI World“ war nicht nur für uns als Unternehmen eine bereichernde Erfahrung, sondern auch ein Spiegelbild des Aufbruchs, den die KI-Branche derzeit erlebt. Die Messe bot eine Plattform für Fachleute, Innovator:innen und Enthusiast:innen, um sich über die neuesten Entwicklungen auszutauschen und gemeinsam die Zukunft der künstlichen Intelligenz voranzutreiben.

In den Gängen und Ausstellungsbereichen spürte man die Energie und Aufregung, die von den verschiedenen Unternehmen und Start-ups ausgingen. Es war inspirierend zu sehen, wie KI-Technologien in den unterschiedlichsten Bereichen angewendet werden – von der Medizin bis zur Logistik, von der Automobilindustrie bis zur Unterhaltung. Mit all diesen Bereichen haben wir bei statworx bereits Projekterfahrung sammeln können, was die Basis für spannende Fachgespräche mit anderen Aussteller:innen bildete.

Unser Fazit

Die Teilnahme an der „Big Data & AI World “ war für uns als KI-Beratung ein großer Erfolg. Die Pac-Man Challenge mit Emotionsanalyse zog zahlreiche Besucher:innen an und bereitete allen Teilnehmenden viel Freude. Es war deutlich erkennbar, dass nicht die KI als solche, sondern insbesondere deren Einbindung in eine anregende Spielerfahrung bei vielen einen bleibenden Eindruck hinterließ.

Insgesamt war die Messe nicht nur eine Gelegenheit, unsere KI-Lösungen zu präsentieren, sondern auch ein Treffpunkt für die gesamte KI-Community. Der Aufbruch und die Energie in der Branche waren deutlich spürbar. Auch der Austausch von Ideen, Diskussionen über Herausforderungen und das Aufbauen neuer Kontakte war inspirierend und vielversprechend für die Zukunft der deutschen KI-Branche.

Wer bei statworx arbeitet weiß, dass eine Party bei uns immer zur rechten Zeit kommt. Nach unserem berauschenden Sommerfest hoch über den Dächern Fankfurts im August 2022 haben wir zum Jahresabschluss geladen zur großen Weihnachtsparty – und dafür unsere heiß geliebte, riesige Küche auf der Konferenzetage für das gesamte Team und alle Partner*innen geöffnet. Und es war wie immer ein rauschendes Fest. Doch eins nach dem anderen …

Die Agenda

Dieses Jahr standen neben den Drinks an der Bar auch einige schöne, besinnliche Punkte auf der Programmagenda. So hatten im Rahmen des Micro-Events „Decorate the Christmas Tree“ die Mitarbeiter*innen die Möglichkeit, unseren nackten Weihnachtsbaum mit individuellen Schmuckstücken zu schmücken. Von Einhörnern, Regenbögen und weihnachtlich bemalten Paracetamol Packungen hing am Ende alles am Baum, was die Individualität unseres Teams unterstreicht. Wir fanden, es sah richtig nice aus.

Besondere Erwähnung muss auch die diesjährige Preisverleihung für den/die Value Carrier 2022 finden. Hierbei hatte das gesamte Team die Möglichkeit, besondere Träger*innen unserer Unternehmenswerte in einem Voting nach oben zu wählen. Unter den Gewinner*innen dieses Votings fand dann eine Auslosung von besonderen Preisen statt und für jede*n Gewinner*in gab es eine individuelle, sehr persönliche Ansprache der Geschäftsführung. Kleiner Ausflug zu unseren Unternehmenswerten:

Bereits 2021 hat sich statworx in mehreren Runden und Sessions, an denen auch die Mitarbeiter*innen beteiligt waren, 7 Unternehmenswerte gegeben, die seither die Maxime unserer Arbeit darstellen. Diese Values sind:

- We run on data.

Daten sind unser Treibstoff. Die Begeisterung für KI-Technologie und datengetriebene Innovation verbindet uns. Aus ihr ziehen wir die Kraft und Inspiration, neue Wege zu gehen und über uns hinauszuwachsen. - We thrive together.

Die Kraft liegt im Team. Immer. Ohne Ausnahme. Gegenseitiges Vertrauen und das Wissen, dass wir gemeinsam mehr bewegen, stehen im Zentrum unserer Zusammenarbeit. Nur so können wir unsere ambitionierten Ziele erreichen. - We grow through challenge.

Die Neugier und Lust daran, uns stets mit neuen Herausforderungen auseinanderzusetzen und daran zu wachsen, sind tief in uns verankert. Wir sehen Chancen in der Veränderung und lernen aus neuen Erfahrungen. - We embrace individuality.

Wir schätzen die Einzigartigkeit jedes Menschen und begegnen einander stets auf Augenhöhe. Unterschiedliche Hintergründe, Einstellungen und Ideen bereichern uns und bilden die Grundlage unseres Erfolgs. - We do what matters.

Wir fokussieren uns auf das, was wirklich zählt. In unseren Projekten arbeiten wir an Lösungen, die nachhaltigen Wert erzeugen. Wir gestalten die Zukunft durch Daten und KI zum Besseren. Für Menschen, Wirtschaft, Gesellschaft und Umwelt. - We own our game.

Verantwortung übernehmen, eigene Ideen umsetzen, groß denken. Wer den Status quo verändern möchte, muss sich dafür mit voller Überzeugung einsetzen. Wir glauben an uns, setzen ehrgeizige Ziele und lassen die Zukunft Wirklichkeit werden. - We care for the crew.

Wir sind mehr als nur Kolleg:innen – wir sind eine Crew. Wir selbst sind unser wertvollstes Asset. Wir achten aufeinander, stehen füreinander ein und schaffen ein harmonisches Arbeitsumfeld, in dem sich alle geschätzt und unterstützt fühlen.

Unsere besonderen Value Carrier dieses Jahr sind:

- An Hoang / Alexander Müller – We run on data.

- Eva Engelhardt – We thrive together. (Gewinnerin)

- Stephan Müller – We grow through challenge.

- Markus Berroth – We embrace individuality.

- Jan Fischer – We do what matters.

- Stephan Emmer – We own our game.

- Andreas Vogl – We care for the crew.

Geschenke, über Geschenke

Doch nicht nur über besondere Leistung kann man bei statworx ordentlich abräumen. Nein, auch für den Zufallsgewinn haben wir dieses Jahr in ausreichendem Maße gesorgt. Nämlich mit unserer großen Christmas Tombola. Schon vor einigen Jahren hat die Tombola sich auf einer Weihnachtsfeier größter Beliebtheit erfreut und hat große Augen bei den Gewinner*innen verursacht. Daher war es genau an der richtigen Zeit, die Lostrommel wieder zu rühren und Geschenke im Gesamtwert von 2.500,00 Euro innerhalb des Teams zu verlosen. Von coolen Preisen wie den Airpods Pro Max, interior von vitra und artemide, Spendengutscheine, merchandising kits und dem handgemachten „Trashy Treasure“ (ein Kartenspiel mit peinlichen und lustigen Fotos aus der Unternehmensgeschichte). Diesjähriger, verdienter Hauptgewinner war unser Kollege Jannik Klauke, der nicht nur ein glückliches Händchen bewiesen hat, sondern auch in besonders großem Maße engagiert ist und damit zum Erfolg des Unternehmens in 2022 beigetragen hat – wir sagen Danke an dieser Stelle.

Und als ob es noch nicht genug Geschenke gewesen wären, haben wir auch dieses Jahr wieder das traditionelle Weihnachtswichteln zelebriert, bei dem sich das Team untereinander mit Lustigem, Nützlichem und Nutzlosem beschenkt hat. Auch hier hatten wir großen Spaß! Danke an die Organisatorinnen und Organisatoren.

Abgerundet wurde der offizielle Teil schließlich von der jährlichen Weihnachtsansprache unseres CEO Sebastian, deren inspirierendem Inhalt auch dieses Jahr alle Anwesenden andächtig gelauscht haben.

Party, food and good vibes!

Zu einem Küchenabriss gehört eine ordentliche Beschallung. Deshalb haben wir ein professionelles Sound Setup kommen lassen und in die Küche ein großes DJ Pult montieren lassen. Gegen 21 Uhr kam schließlich unsere DJane Freundin Elisa Cielo (man kennt sie in Frankfurt sehr gut), die uns auch schon auf dem Sommerfest ordentlich Dampf gemacht hat. Während wir auf dem Sommerfest ein Lineup von 6 DJs hatten, haben wir dieses mal mit Elisa und ihrem DJ Kollegen Anton Vorlieb genommen, was sich aber ebenfalls als Glücksgriff herausgestellt hat. Coole Elektronische Beats haben in der gesamten Konferenzfläche gedröhnt und uns bis halb 5 am Morgen wach gehalten. Ernährt wurden wir von zahlreichen Süßigkeiten, die vom Team mitgebracht wurden, gefühlt einem Tieflader voller Pizza und einem sensationellen Midnight Snack durch die Mädels von „Gudrun Kocht“, die sich hier in Frankfurt auf hausgemachte, natürliche Suppen und Eintöpfe spezialisiert haben – genau das Richtige um dem Kater den Kampf anzusagen.

Als die letzten Gäste gegangen waren, blieb ein Kollege einfach direkt im Büro und leistete – mehr oder weniger effektive – Nachtwache.

Samstag und Sonntag rückte schließlich unser Aufräumteam an und schon zum Zeitpunkt der Veröffentlichung dieses Artikels sah unsere Küche schon wieder aus, als wäre nichts gewesen.

Wir hatten eine rauschende Party, freuen uns jetzt auf eine besinnliche Zeit mit unseren Familien und sind schon gespannt, wann, wo und wie in 2023 wieder ordentlich gefeiert wird.

In diesem Sinne wünschen wir allen Leserinnern und Lesern ein fröhliches Weihnachtsfest und einen guten Start ins neue Jahr! Cheers!

Im letzten Monat nahmen wir mit einer Gruppe von Projektmanagern aus unserer Abteilung AI Development an der UXDX EMEA-Konferenz in Dublin teil. UXDX steht für „User and Developer Experience“ und wir wollten mehr über Produktmanagement erfahren, insbesondere wie man die Produktentwicklung beschleunigen kann. Die Konferenz hat uns nicht enttäuscht! Sie war vollgepackt mit hervorragenden Vorträgen und nützlichen Workshops. Nach nur wenigen Tagen kehrten wir mit einer Fülle innovativer Ideen und Techniken nach Hause zurück, die wir nutzen werden, um unsere Produkte noch weiter zu verbessern.

Die Konferenz dauerte insgesamt drei Tage und war in zwei Teile gegliedert. An den ersten beiden Tagen standen Vorträge, Panels und Foren auf dem Programm. Am dritten Tag wurden mehrere interessante Workshops angeboten. Wir beschlossen, über das Wochenende zu bleiben und auch in unserer Freizeit einige Teambuilding-Aktivitäten zu unternehmen.

Zwei volle Tage mit Vorträgen, Diskussionsrunden und Foren

Die ersten beiden Tage der UXDX EMEA-Konferenz konzentrierten sich auf Vorträge, Panels und Foren. Während die Vorträge meist von einzelnen Referenten gehalten wurden, die ihre Erkenntnisse zu bestimmten Themen mitteilten, setzten sich die Panels aus mehreren Experten zusammen, die diese Themen aus verschiedenen Blickwinkeln diskutierten und dabei auch das Publikum einbezogen haben. In den Foren führten die Teilnehmer:innen ein moderiertes, aber ansonsten unstrukturiertes, freies Gespräch direkt miteinander. Es standen immer mehrere Foren gleichzeitig zur Auswahl, und die Aufteilung in kleinere Diskussionsgruppen förderte die aktive Teilnahme.

Einer unserer persönlichen Highlight-Vorträge war „From Visual Design to Vision Design: Die Rolle der Produktdesigner bei der Gestaltung der Produktausrichtung“. Dieser Vortrag vermittelte uns nützliche Einsichten, insbesondere für unsere größeren Projekte, da er deutlich machte, wie wichtig es ist, sich auf eine längerfristige Vision zu konzentrieren und nicht auf die unmittelbare Umsetzung. Je größer das Projekt wird, desto mehr Einfluss hat das Produktteam auf die Gesamtausrichtung des Produkts. Daher ist es ratsam, neben den kurzfristigen Zielen von Anfang an auch über die Vision nachzudenken.

Eines der Panels, das uns wohl am meisten inspiriert hat, war „How leaders can empower their teams“. Als Entwicklungs- und Beratungsunternehmen organisieren wir unsere Projekte nach dem agilen Ansatz. Das kann einen großen Spielraum für die Projektmitglieder bedeuten, wie sie ihre Aufgaben erfüllen wollen. Wir haben gelernt, dass moderne Arbeit intrinsische Motivation erfordert, was bedeutet, dass sich auch die Rolle des (Projekt-)Leiters verändert, weg vom bloßen Abhaken von Aufgaben hin zum Empowerment von Teams bei der Produktentwicklung.

Ein sehr aufschlussreiches Forum zu Entwicklungstechniken war „Modern Development Principles“, wo wir kritisch diskutierten, ob Prinzipien wie SOLID heute noch befolgt werden sollten und welche Alternativen für moderne Software-Stacks in Frage kommen. Wir sprachen auch über einige der neuesten Erkenntnisse zu Themen wie robuste Softwaretestmethoden aus einer Vielzahl von Blickwinkeln und über verschiedene Unternehmen hinweg.

Insgesamt hatten wir an den ersten beiden Konferenztagen eine großartige Zeit und konnten viele neue Ideen, Erkenntnisse und Techniken sowohl in Bezug auf die Projektabwicklung als auch auf die Produktentwicklungsmethoden mitnehmen, die uns helfen werden, unsere Produkte und unsere Zusammenarbeit weiter zu verbessern.

Ein Tag mit Workshops

Am dritten und letzten Tag der diesjährigen UXDX EMEA-Konferenz besuchten wir mehrere Workshops mit dem übergeordneten Ziel, dass die Teilnehmer:innen praktische Erfahrungen mit neuen Tools und Techniken sammeln. Die Workshops waren auf zwei Stunden zugeschnitten und förderten die gemeinsame Arbeit in kleinen Gruppen. Die Moderatoren der Workshops, die von führenden Unternehmen der Branche wie Figma, AWS und SAP kamen, behandelten Themen, die von Designsystemen, Designschulden und der Strukturierung komplexer Probleme bis hin zur Kundenzentrierung reichten.

In dem von Rory Madden, dem Gründer von UXDX, geleiteten Workshop „Breaking down complex problems“ ging es um die Identifizierung von Problemen, deren Aufschlüsselung und deren Lösung. Eine Kernaussage des Workshops war, dass die Problemerkennung strukturiert werden kann, indem man eine User Journey aufschreibt und die verschiedenen Schritte entlang dieser User Journey aufschlüsselt. Im Bereich Data Science hilft dies beispielsweise dabei, mehr aus der Perspektive eines Endnutzers zu denken als aus der Perspektive eines Entwicklers. Die Verwendung von User Journeys kann auch dabei helfen, herauszufinden, welche Aspekte eines Produkts durch verschiedene Designentscheidungen beeinflusst werden, was zu fundierteren Entscheidungen beim Scoping einer Lösung für ein bestimmtes Problem führt. Ein weiteres wichtiges Thema, in das wir Einblick erhielten, betrifft Annahmen. Erwünschtheit, Durchführbarkeit, Machbarkeit und Nutzbarkeit sind die vier Hauptrichtungen, die es zu berücksichtigen gilt. Eine Pre-Mortem-Analyse kann auch zu zusätzlichen Erkenntnissen in Bezug auf bestehende Annahmen führen.

Im Workshop „Building customer-centric products“ von Daria Tarawneh, Head of UX bei AWS, erhielten wir einen Einblick in den Produktentwicklungsansatz bei AWS. Bei ihrem Ansatz für das Produktdesign beginnen sie „am Ende“ mit der Benutzererfahrung und arbeiten sich von dort aus bis zur technischen Implementierung vor. Ein von AWS genutztes Medium zur Sicherstellung der Kundenzentrierung, insbesondere in den frühen Phasen der Produktentwicklung, sind Pressemitteilungen. Produktmanager sollten bereits zu Beginn der Produktentwicklung an der Pressemitteilung arbeiten, da so sichergestellt wird, dass die richtigen Fragen beantwortet werden, z. B. wer genau die Endnutzer sein werden. Während des Workshops haben wir daher auch unsere eigenen Pressemitteilungen geschrieben. Diese Pressemitteilungen sind nicht unbedingt dazu gedacht, irgendwo veröffentlicht zu werden, aber sie sind so geschrieben, als ob sie es würden. Das hilft, relevante Fragen für eine bessere Produktgestaltung und -entwicklung herauszustellen.

Insgesamt haben uns die Workshops sehr gut gefallen, da sie tiefere Einblicke in Themen des Produktmanagements und der User Experience ermöglichten. Alle diskutierten Probleme wurden in kleinen Gruppen von interdisziplinären Teams aus Produktmanagern, UX-Designern und Entwicklern angegangen, was weitere Einblicke in den Umgang mit unterschiedlichen Problemstellungen bot.

Abendprogramm

Ein wichtiger Aspekt von Konferenzen ist neben Vorträgen, Foren und Workshops natürlich auch das Networking und das Kennenlernen von Mitarbeitern und Managern anderer Unternehmen. Das Organisationsteam der UXDX EMEA-Konferenz in Dublin hat dies mit Aktivitäten wie einer geführten Sightseeing-Tour, einem Stadtlauf für etwas Bewegung und einer Kneipentour hervorragend umgesetzt.

Die gesamte Gruppe beschloss, ihren Aufenthalt in Dublin auch auf das Wochenende auszudehnen, um einige unterhaltsame Teamaktivitäten zu unternehmen. Einige von uns besuchten das Guinness Storehouse, um die lokale Brautradition kennenzulernen und zu verkosten. Später traf sich die gesamte Gruppe, um das Trinity College zu besuchen und an einer Verkostung im Whiskey-Museum in der Innenstadt teilzunehmen. Wusstet ihr, dass Whiskey eigentlich „Wasser des Lebens“ bedeutet? Am Abend gingen wir in den Stadtteil Temple Bar, um etwas zu essen und ein paar Biere zu trinken – ein rundum gelungenes Erlebnis.

Mit einer Fülle von Eindrücken und Ideen nach Hause zurückgekehrt

Die diesjährige UXDX EMEA-Konferenz in Dublin war für uns alle ein absolutes Highlight. Die Vorträge, Panels, Foren und Workshops waren alle sehr aufschlussreich und informativ und wir sind mit einer Fülle von Eindrücken, Ideen und Techniken nach Hause zurückgekehrt, die wir nutzen werden, um unsere Produkte noch weiter zu verbessern. Besonders gut gefallen haben uns die Workshops über die Bedeutung von Kundenorientierung und Problemidentifizierung, zwei Themen, die für jedes Produktdesign entscheidend sind. Insgesamt hatten wir eine tolle Zeit und können das UXDX-Konferenzformat jedem, der im Produktmanagement tätig ist, wärmstens empfehlen. Darüber hinaus fand die Konferenz in Dublin statt, einem spaßigen Ort, an dem man sich gerne aufhält.

Wir waren auf der vuejs.de Konferenz! Warum moderne JS-basierte Frameworks wie Vue.js bei der visuellen Darstellung von Data Science und UI unabdingbar geworden sind und was wir darüber in Berlin gelernt haben – davon wollen wir euch in diesem Blogeintrag berichten.

Laut der State of Javascript Umfrage zählt Vue.js schon seit einigen Jahren zu den beliebtesten und bekanntesten Frontend-Frameworks. Besonders hervorzuheben sind dabei die niedrige Einstiegshürde, die große und aktive Community sowie die Tatsache, dass hinter dem Projekt nicht einer der Techgiganten, sondern ursprünglich allein Vue-Gründer Evan You steht. Aus diesen Gründen beschäftigen wir uns bei statworx schon länger mit dem Framework und hatten deshalb große Vorfreude auf die Vue.js Conf 2022 in Berlin.

Unsere drei Haupteindrücke der Konferenz

Die Konferenz bestand hauptsächlich aus halbstündigen Talks, die durch ihre Vielfalt das breite Anwendungsspektrum und die verschiedenen Einsatzgebiete von Vue.js Frontends aufgezeigt haben. Mehr Details zu den Talks finden sich hier. Um die Eindrücke der Konferenz wiederzugeben, fassen wir im Folgenden unsere Key Takeaways zusammen.

Die Vue.js Community zeigt sich als offen, freundlich und gut organisiert

Die kompetenten Speaker sind zu einem großen Anteil Mitglieder des Vue.js Core-Teams. Dies und die live Q&A Session zu Beginn mit Evan You, dem Begründer von Vue.js, sorgten durchweg für hochqualitative und relevante Beiträge. Unter anderem wurde hier auch die letzte Erweiterung von vue2 auf vue3 thematisiert und wie man mit Legacy Projekten und deren Überführung umgehen kann.

Auch der Veranstaltungsort “Bolle Festsäle” war eine gute Wahl, da er für eine freundliche und lebendige Atmosphäre sorgte. Das Organisations-Team bewies auch ein gutes Händchen für Speis und Trank, so wurde im Stundentakt für abwechslungsreiche Verkostung gesorgt. Die Bühne für eine gelungene Konferenz war also bereits von Beginn an gegeben!

In den vielen Live-Coding Session innerhalb der Talks zeigte sich auch, dass die Community, geprägt vom Open Source Gedanken, aufgeschlossen, hilfsbereit und diskussionsfreudig ist. Dass auch Mitgliedern des Core-Teams einfache Fehler beim Coden passieren (sicherlich nur der Tatsache geschuldet, vor einem großen Publikum live zu coden), ermutigt zudem, die eigenen Fehler nicht zu kritisch zu sehen.

Tests erhöhen das Vertrauen in die entwickelten Frontends

Die Beiträge von Debbie O’Brien und Markus Oberlehner haben sich mit dem Thema Testing von Frontends befasst. Die Aussage der Speaker, dass Testing ein wichtiger Bestandteil ist, den man nicht vernachlässigen, sondern vom Beginn eines Projektes mit integrieren sollte, traf im Publikum auf offene Ohren und Zustimmung. Es wurden neben den gängigen Tools Cypress und Vitest, auch neue Tools wie Playwright vorgestellt und besonders auf Tipps und Tricks zur Anwendung eingegangen. Hierbei zeigte sich, dass es nicht das „eine“ Tool gibt, das alles kann, sondern die Kombination und zielorientierte Anwendung entscheidend ist. Testing soll neben der Prüfung der Funktionalitäten häufig vor allem schnelles Feedback liefern, sodass Bugs und Fehler zügig gefunden und behoben werden können.

So kommt es nicht nur darauf an „wie“ getestet wird, sondern auch auf das „Was“. Im anschließenden Gespräch mit Markus Oberlehner hat sich daher auch unsere Einstellung bestätigt, dass Testing – wie so vieles – kein Schema F aufweist. Stattdessen sind die Erfahrung und Expertise eines Entwicklers gefordert, die richtigen Tests mit den richtigen Tools zu schreiben.

Fortbildung findet auch in der Pause statt

Während den Mittags- und Kaffeepausen gab es neben der Verpflegung noch weitere Möglichkeiten, sich fortzubilden und zu vernetzten. So gab es zum Beispiel ein „Live Hacking“ einer Demo Webpage, bei dem eine Sicherheitslücke ausgenutzt wurde, um das Access Token des Administrators herauszubekommen. Die ausgenutzte Sicherheitslücke war die ungeprüfte User-Eingabe. In das User-Eingabefeld wurde statt den Login-Daten bösartiger HTML-Code eingefügt, der bei der Ausführung auf sensible Information, wie das Access Token, zugreift. Da die User-Eingabe ungeprüft blieb, konnte der bösartige HTML-Code ausgeführt werden. Diese Art von Angriff wird Cross-site Scripting (XSS) Angriff genannt. Die Demo zeigte die Wichtigkeit der sorgfältigen Bereinigung und Validierung der User-Eingaben durch die Entwickler, um sich vor solchen Angriffen zu schützen.

Von der Konferenz zurück in den Alltag

Die gut getakteten Vorträge der eintägigen vuejs.de Konferenz sorgten für ein volles Programm, das Lust auf mehr macht. Daher kehren wir mit neuen Ideen und Tatendrang zurück und versuchen die Eindrücke wirken zulassen. Getreu einem unserer statworx-Firmenwerte „We grow though challenge“, werden wir in unseren Projekten weiterhin daran arbeiten, die vielzähligen und komplexen Aufgaben unter einen Hut zu bringen. Denn:

Ein gut designtes, getestetes und sicheres Frontend kann den Wert einer Data Science Applikation immens steigern, da es für den Nutzer der erste (und oft auch einzige) Kontakt zum zu Grunde liegenden Modell ist.

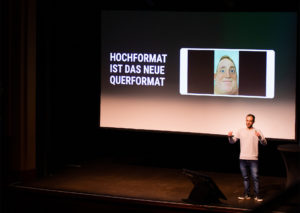

Im April 2022 fand im Bierhübeli in Bern die erste Ausgabe des Unfold Events statt, welches von unserer Partnerfirma Cleverclip ins Leben gerufen wurde – und wir von statworx waren natürlich auch dabei. Das Event stand unter dem Motto „Raus aus der eigenen Branche, rein ins Unbekannte: Gemeinsam nehmen wir neue Blickwinkel ein und erweitern unseren Horizont.“

Auf dem Programm stand ein Nachmittag voller Keynotes zu zukunftsorientierten Themen, Networking Sessions und vielem mehr! Auch wir haben uns tatkräftig am Event beteiligt: Unsere Kollegin Livia Eichenberger hat eine Keynote zum Thema Bias in AI gehalten (bzw. halten lassen 👀), und als Sponsoren des Events hatten wir zudem eine Booth vor Ort. Was beim Betreten der Eventhalle im Bierhübeli direkt aufgefallen ist: Die unglaubliche Atmosphäre und das diverse, durchmischte Publikum. The stage was set!

Die Talks beim Unfold 2022

Herzstück des Events waren die Keynotes zu solch verschiedenen Themen, dass ich sie hier gar nicht zusammenfassen kann, sondern direkt meine Insights von den Talks mit euch teilen möchte:

Talk 1: Prof. Dr. Andreas Hack

„Sich als Unternehmen als nachhaltig zu betiteln, bewirkt beim Kunden genau das Gegenteil.“ Dieser Aussage ging Prof. Dr. Andreas Hack in seiner Keynote zum Thema Nachhaltigkeit auf den Grund. Seine Kernaussagen waren:

- Das Image einer Firma im Bezug auf Nachhaltigkeit hat viel mehr mit der Glaubwürdigkeit der Firma bzw. Marke zu tun, als damit wie eine einzelne Nachhaltigkeitskampagne aufgebaut ist.

- Glaubwürdigkeit in jeglichen Aspekten, auch jenseits der Nachhaltigkeit, ist essenziell dafür, dass man einem Unternehmen glaubt, dass es nachhaltig ist.

- Achtung: Stark umworbene Nachhaltigkeitskampagnen können auch mal wenig oder gar das Gegenteil bewirken. Als Beispiel dazu nannte Prof. Dr. Hack eine Kampagne von Krombacher, bei der für jeden Kasten Bier 1m^2 Regenwald erhalten wird. Er nannte die Aktion humorvoll: „Wir saufen für den Regenwald“.

Talk 2: Livia Eichenberger

„Wir kommen täglich mit AI in Berührung – bloß merken wir es meistens nicht.“ So lautete der Teaser der Keynote unserer Kollegin Livia. Aber ihre Keynote ging noch weiter und zeigte auf, welche Risiken durch die Nutzung von KI-Technologien in sich birgt. Leider konnte Livia nicht in Person am Unfold teilnehmen und ihre Keynote halten. Freundlicherweise hat sie kurzerhand eine virtuelle Helferin gefunden, den AI Avatar Rosa. 🦾🤖 So konnte die Message der Keynote trotzdem im Bierhübeli überbracht werden. Besonders zu highlighten sind folgende Take-aways:

- Menschliche Biases spiegeln sich in den Daten, auf denen KI-Systeme trainiert werden. Wenn man sich nicht um diese Probleme kümmert, werden diese Biases auf KI-Systeme übertragen.

- Für unvoreingenommene KI brauchen wir eine diverse KI-Community!

- Wenn wir richtig vorgehen, können wir als Gesellschaft Hand in Hand mit KI-Systemen den Bias in der Gesellschaft durchbrechen. Die Zeit zu Handeln ist jetzt!

Talk 3: Alan Frei

Alan Frei’s Credo lautet: „Um eine Firma aufzubauen, braucht es am Anfang vor allem eines: gar nichts!“ Unter diesem Motto nahm Alan die Leute mit auf seine Reise als Unternehmer, und gab uns seine 10 Takeaways für die Gründung eines Startups mit auf den Weg, unter anderem:

- Focus: Fokussiere dich auf eine Idee.

- Target group: Arbeite an einem Problem, was dich selbst auch betrifft.

- No fear: Habe keine Angst zu Scheitern, die Liste von Alan’s Fails hatte mit Schriftgrösse 10 knapp Platz auf einer Folie (Danke für deine Ehrlichkeit Alan!).

- Fun Fact: Alan hat es sich nun zum Ziel gesetzt an der Winterolympiade 2026 für die Philippinen zu starten. Auf die Frage nach der Disziplin kam bloss die Antwort: „Das müssen wir noch herausfinden.“ 🤔

Talk 4: Jürg Grossen

„Die Schweiz kann mit hoher Innovationskraft und Offenheit zur Vorreiterin beim Umwelt- und Klimaschutz werden.“ Dessen ist sich Jürg Grossen sicher. Was wir dafür tun müssen:

- Die Möglichkeit haben, im Notfall Selbstversorger:in zu sein.

- Einen effizienteren Umgang mit Strom. Schluss mit der Verschwendung! Ein Helfer kann IOT sein, wie Jürg Grossen auch in seiner eigenen Firma eindrücklich aufgezeigt hat.

- Ein starkes Investment in die Solarenergie.

Talk 5: Nicholas Hänny

Wenn es nach Nicholas Hänny, Gründer von Nikin, geht, dann ist eins gewiss: „Es geht nicht um die Idee, es geht um die Umsetzung.“ Konkret redet Nicholas hier von den Bereichen Marketing und Branding. Meine Takeaways seiner mit Humor gespickten Keynote waren:

- Nicht jeder Marketing Post oder jede Kampagne muss genau geplant sein, es kann schon hilfreich sein einfach aktiv das zu posten was man gerade denkt oder macht.

- Nikin wollte ursprünglich eine Skater Marke werden. Als Nicholas und sein Team dann merkten, dass auch andere Leute ihre Produkte kaufen, haben sie sich schnell von diesem Vorhaben gelöst.

- Das Wald-Office gibt es nicht 😭 Für mehr Infos zum Wald-Office, siehe hier.

Afterparty

Nach den Talks und einer anschliessenden, sehr aktiven Networking-Session verschob sich die Action in das neu im „Jungle-Look“ designte Cleverclip Office im Herzen Berns. Dort haben wir bei dem einen oder anderen Bier, tollen Leuten und bei entspannter Atmosphäre den Abend ausklingen lassen.

Unfold geht 2023 in die zweite Runde

Neugierig geworden? Cleverclip hat bereits das Datum für das Folgeevent der Unfold verkündigt. Am 30. März 2023 findet die Unfold wieder im Bierhübeli in Bern statt. Alle Infos findet ihr auf der Website: https://unfold-event.ch/

Wir möchten uns nochmal bei Ceverclip für die super Organisation bedanken und sagen: Bis nächstes Jahr!

Intro

statworx hat dieses Jahr zum ersten Mal am START Summit x Hack teilgenommen. START fand in den OLMA Messen in St. Gallen statt und wurde von Studierenden der Universität St. Gallen – meiner Alma Mater – organisiert. Diese Doppelveranstaltung bestand aus dem START Summit, Europas führender Studierendenkonferenz für Unternehmergeist und Technologie, und dem START Hack, Europas innovativstem Hackathon. Mehr als 3.500 Gründer:innen, Investor:innen, Studierende und Besucher:innen aus der ganzen Welt nahmen an der Veranstaltung teil. Da statworx der Hauptsponsor des START Hack war, gehörte unser CEO, Sebastian Heinz, zur Jury, die das Gewinnerteam des Hackathons auswählte. Außerdem war ein Teil unseres Swiss und AI Ventures Teams an unserem Stand auf der START Summit Messe anwesend. Nach zwei sehr spannenden, beeindruckenden und aufschlussreichen Tagen möchte ich meine sieben wichtigsten Erkenntnisse mit euch teilen.

7 Erkenntnisse vom Start Summit X Hack 2022

AI ist überall

Nicht nur, dass fast alle Hackathon-Lösungen datengetrieben waren, es gab auch viele Start-ups und Unternehmen mit KI-Produkten und -Dienstleistungen auf der Messe, wie zum Beispiel der KI-Zahnarzt von zaamigo, der deine Zähne analysiert und dir sagt, wann es Zeit ist, zum Zahnarzt zu gehen. Außerdem war KI ein zentrales Thema in vielen Vorträgen, Diskussionen und Workshops. Das hat mir wieder einmal gezeigt, dass KI überall ist und die Schlüsseltechnologie unserer Zukunft ist.

Die Zukunft ist nachhaltig und menschenzentriert

Es hat mich sehr gefreut zu sehen, dass die Ideen, Technologien und Lösungen, die auf dieser Veranstaltung vorgestellt wurden, darauf ausgerichtet waren, eine bessere Welt zu schaffen, sowohl für die Umwelt als auch für uns Menschen. Das war auch ein wichtiges Kriterium bei der Entscheidung der START Hack-Jury für das Gewinnerteam, das eine neue Methode zur Integration menschlicher Eigenschaften in digitale Konversationen entwickelt hat, um schädliche Inhalte in Online-Diskussionen zu reduzieren.

Das Metaverse kommt

Die Schaffung von Metamuseen zum Verkauf digitaler Kunst, Diskussionen über die Relevanz von Rezensionen im Metaverse und Ideen, wie psychologische Beratung über einen anonymen Avatar effektiver sein könnte – die Möglichkeiten und Visionen des Metaverse waren allgegenwärtig. Das Metaverse, unsere zweite Welt, eine virtuelle Realität, könnte schneller kommen, als wir denken.

Technologische Lösungen umfassen mehr als Datenverarbeitung

Der Pitching-Wettbewerb der START Hack-Finalist:innen hat gezeigt, dass die Entwicklung nachhaltiger und effektiver technischer Lösungen viel mehr umfasst als die Verarbeitung von Zahlen und Programmierung, nämlich:

- Das Problem in seinem Kern erkennen.

- Die jeweiligen Stakeholder verstehen.

- Vorhandene Lösungen recherchieren.

- Ein funktionierendes Geschäftsmodell entwickeln und das wiederum einem Publikum verständlich präsentieren.

Studierende rocken

Nicht nur die am START Hack teilnehmenden Studierenden haben innovative, kreative und zukunftsweisende Lösungen entwickelt. Der START Summit x Hack wurde ausschließlich von Studierenden der Universität St. Gallen organisiert. Sie managen ein internationales Hybrid-Event, das jedes Jahr über 3.000 Menschen aus der ganzen Welt anzieht. Hut ab!

Einen ansprechenden Stand zu gestalten ist eine Herausforderung

Einen Stand auf einer Messe wie dem START Summit zu haben ist eine Sache, aber damit Leute anzulocken eine ganz andere: Einerseits haben wir festgestellt, dass unser Slogan „we create the next“ zwar zum Nachdenken anregt, die Leute aber eher verwirrt, als dass er sie dazu bringt, mit uns am Stand zu sprechen. Glücklicherweise stellte uns unser Marketingteam ein informationsreicheres Roll-up zur Verfügung. Andererseits ist ein Monitor mit bewegten Inhalten und bunten Bildern ein echter Publikumsmagnet – vielen Dank an das AI Ventures-Team dafür.

Meine statworx Kolleg:innen sind die Besten

Schließlich hat mir diese Veranstaltung gezeigt, was für wunderbare, kluge und fürsorgliche Menschen wir bei statworx haben. Während und vor der Veranstaltung halfen sie mir bei der Organisation auf jede erdenkliche Art und Weise. Selbst spontane Änderungen wurden unkompliziert und hilfsbereit gehandhabt. Unser Teamgeist und unsere positive Ausstrahlung schien auch von anderen wahrgenommen zu werden: Die Hacker:innen waren begeistert von der charismatischen 3-Minuten-Rede unseres Geschäftsführers, und die Besucher:innen unseres Standes machten uns mehrfach Komplimente, was für sympathische und aufgeschlossene Menschen wir in unserem Unternehmen haben.

Fazit

Ich möchte mich bei allen Veranstalter:innen von START Global bedanken, die diese fantastische Veranstaltung möglich gemacht haben, und bei meinen Kolleg:innen für ihre Unterstützung, ihre positive Energie und ihre gute Laune! Ich freue mich schon jetzt auf die START Summit x Hack 2023!

Am vergangenen Freitag, den 31. Dezember, ging ein erstaunliches Jahr zu Ende, sowohl für mich als auch für STATWORX. Das Jahr 2021 war geprägt von (zu) viel Arbeit, großen Erfolgen und Siegen, aber auch bitteren Niederlagen und Verlusten. Im Laufe eines Jahres passieren so viele Dinge, die es wert sind, erlebt zu werden, seien sie gut oder schlecht, und die mich immer wieder daran erinnern, warum ich das, was ich tue, liebe. 2021 war mit Sicherheit eines der aufregendsten, herausforderndsten aber auch lohnendsten Jahre meiner bisherigen, beruflichen Laufbahn. Wie auch im letzten Jahr habe ich beschlossen, dieses Jahr mit einem kurzen Rückblick auf 2021 zu beginnen und einen Ausblick darauf zu geben, was im Jahr 2022 alles auf dem Programm steht. Spoiler-Alarm: Dieses Jahr wirft bereits große Schatten voraus – durch den Aufstieg von statworx next.

2021 – Das Jahr im Rückblick

Trotz der anhaltenden Pandemie hatte STATWORX in 2021 ein sehr erfolgreiches Geschäftsjahr. Nach einem eher unspektakulären Jahr 2020 ist es meinem Team und mir gelungen, Umsatz, Größe und Impact unseres Unternehmens im Jahr 2021 deutlich zu steigern. Vor allem das wichtige 4. Quartal hat in diesem Jahr anders zugeschlagen und steigerte unsere Umsatz- und Gewinnzahlen nochmals erheblich. Neben den reinen Zahlen haben unsere Teams viele großartige Dinge erreicht: Wir haben neue Abteilungen und Funktionen eingeführt, sowohl im Front- als auch im Backoffice. Wir verwenden jetzt OKR als unser offizielles Zielsetzungsframework. Wir hatten einen Exit unserer erste Start-up-Investition an Databricks. Wir haben in drei weitere KI-Start-ups investiert. Wir sind mehreren Verbänden beigetreten, wie dem KI Bundesverband und AI Frankfurt. Wir haben Jugendliche in KI weitergebildet. Wir haben an großartigen Events wie dem Fifteen Seconds Festival in Graz, der Startup Safari in Frankfurt, deploy(impact) oder SDS201 in der Schweiz teilgenommen und dazu beigetragen. Und so weiter, und so weiter. Die Liste ließe sich endlos fortsetzen. Hier noch einige persönliche Eindrücke aus diesem großartigen Jahr bei STATWORX.

Nicht zuletzt war 2021 auch unser 10-jähriges Firmenjubiläum! Im Januar 2011 ging die erste STATWORX-Website online. Dazu habe ich einen eigenen Blogbeitrag geschrieben. Das Jahr 2021 bescherte uns einige wirklich tolle Erlebnisse, brachte gleichzeitig aber auch viele neue Herausforderungen für unser wachsendes Unternehmen mit sich.

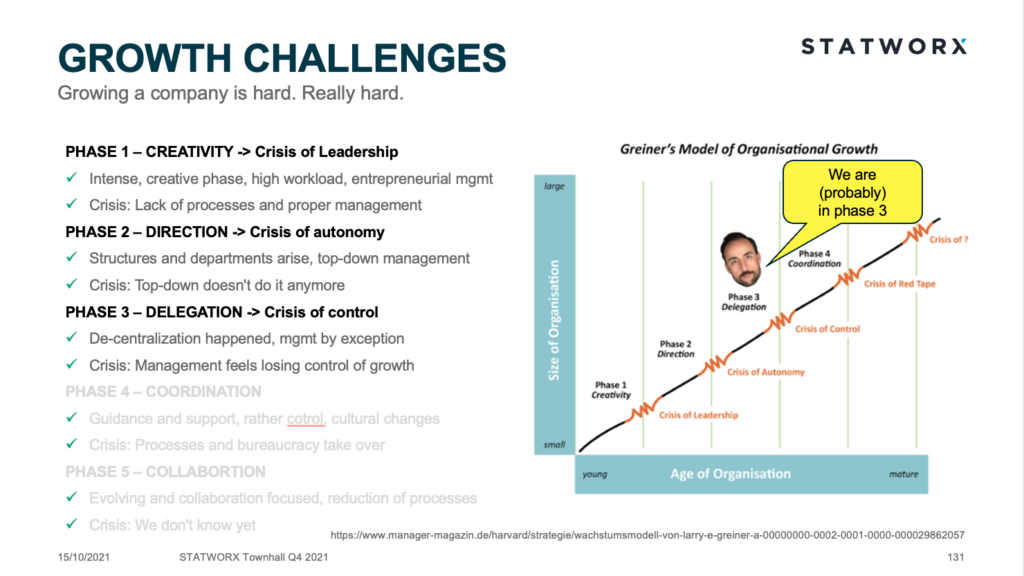

Erfolge und Herausforderungen gehen Hand in Hand, wenn es um Wachstum geht

Ein Unternehmen wachsen zu lassen ist schwer. Wirklich schwer. Während wir uns Schritt für Schritt der 100-Mitarbeiter-Marke nähern, ändern sich viele Dinge im Unternehmen – und müssen sich ändern. Aus „Neuigkeiten beim Mittagessen verbreiten“ wird „offizielle Kommunikation“. Aus „Das war schon immer so“ wird ein dokumentierter Prozess. Beförderungskriterien werden standardisiert. Karrierewege werden entwickelt. Persönliche Situationen ändern sich. Mitarbeitende verlassen das Unternehmen, um neue Chancen zu ergreifen. Interne Politik kommt auf. You know the deal. Nicht falsch verstehen, Wachstum ist eine gute Sache und etwas, auf das wir stolz sind, aber es hat seinen Preis. Wie bei jedem anderen Objekt bedeutet mehr Masse auch mehr Schwerkraft – mehr Dinge werden angezogen. Meistens positive Dinge, aber auch Herausforderungen und Probleme. Je größer das Unternehmen wird, desto schwieriger wird es, das Gesamtkonstrukt zusammenzuhalten. Das erinnerte mich an eine Vorlesung zu Greiners Wachstumsmodell aus meiner Zeit and der Universität:

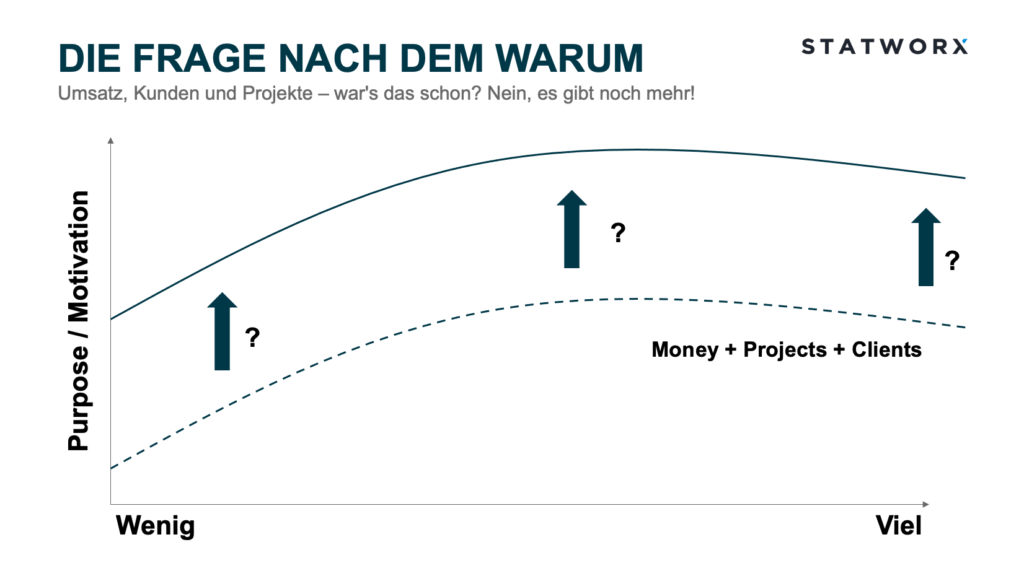

Wenn ein Unternehmen wächst, wird schließlich die Bedeutung und das Verlangen nach einem gemeinsamen Ziel, einer gemeinsamen Vision unausweichlich, um das Unternehmen und alle seine Mitarbeiter gemeinsam und zielgerichtet in die Zukunft zu führen. In der Vergangenheit waren viele Teammitglieder bei STATWORX stark motiviert, weil sie sahen, dass das Unternehmen erfolgreich und auf dem Markt nachgefragt war. Das berühmte „Why“ war für viele jedoch lange Zeit unklar. Man wuchs mit dem Unternehmen. Monetäre Erfolge und Wachstum haben uns die ersten Kilometer des Weges getragen. Aber motivieren sie auf einer linearen Skala? Eindeutig nein. Nicht jeder neue Kunde erzeugt die gleiche Motivation und Begeisterung wie der erste große Deal.

STATWORX hat mir also die Frage gestellt: Was treibt und an? Auch in schwierigen Zeiten, wie im COVID-Jahr 2020? Was ist unser Ziel? Warum tun wir, was wir tun? Ich musste Antworten auf diese Fragen finden. Damit begann die Reise zu statworx next.

Die Reise zu statworx next

Angetrieben von diesen Fragen begab ich mich zwischen den Jahren 2020 und Januar 2021 auf eine Reise, um eine Vision und ein Ziel für die Zukunft von STATWORX zu entwickeln. Rückblickend war dies – ohne Frage – eines der wichtigsten Dinge, die ich je für das Unternehmen getan habe. Aber auch eine der schwierigsten. Ich habe viele Tage und Nächte mit Recherchen und Brainstorming verbracht, mich durch endlose Artikel, Videos und Bücher gearbeitet, bis ich schließlich an meinem Ziel ankam. In der ersten Januarwoche 2021 wurde statworx next geboren. Die Antwort auf unser Warum. Eine Vision. Ein Ziel.

In einer motivierenden Rede in der letzten Januarwoche 2021 habe ich vor allen Mitarbeitern des Unternehmens statworx next vorgestellt und dargelegt, was ich mir für STATWORX in der Zukunft vorstelle. In Anlehnung an Cameron Herolds „Vivid Vision“-Ansatz habe ich die gesamte Vision in einem Dokument niedergeschrieben, damit jeder klar und deutlich versteht und sich vorstellen kann, was ich vor meinem inneren Auge sehe. Die „Vivid Vision“ ist ein schriftlicher Ausdruck dessen, wie das Unternehmen in Zukunft aussehen und sich anfühlen soll. In dem Dokument beschreibe ich STATWORX in der Zukunft, wobei ich alle wichtigen Bereiche des Unternehmens hervorhebe: Geschäftsbereiche, Dienstleistungen, Produkte, Mitarbeiter, Kultur usw.

Aber statworx next ist mehr. Es hat einen tiefen, inspirierenden Kern. Er hat eine Bedeutung. Es gibt unserem Unternehmen einen Grund, das zu tun, was wir tun, so wie wir es tun. Es ist ein Leuchtturm für jeden Mitarbeitenden, der unseren Weg des Wachstums sowie unsere Rolle als Unternehmen in unserer heutigen und zukünftigen Wirtschaft, Gesellschaft und Umwelt definiert.

Nach der Präsentation von statworx next hat sich das gesamte Unternehmen sofort angefangen zu bewegen. Es wurden spezielle Visions-OKRs entwickelt, die sich herunterkaskadieren auf unsere Unternehmensziele, Geschäftsabteilungen und Backoffice-Teams. Es wurden Mitarbeiter für unsere neuen Geschäftsbereiche eingestellt, die aus statworx next hervorgegangen sind. Interne Initiativen wurden an der Schnittstelle zwischen statworx next und unserem Kerngeschäft gebildet. Die Mitarbeiter begannen, an Innovationsprojekten zu arbeiten. Die Energie war wahnsinnig. Das zu sehen, hat mir die elementare Bedeutung des „Why“ in einem Unternehmen klar vor Augen geführt. Lektion gelernt.

Das ganze Jahr 2021 hindurch hat das gesamte Unternehmen hinter den Kulissen hart an statworx next gearbeitet. Jetzt, im Jahr 2022, Ende Januar, werden wir statworx next offiziell unseren Kunden und der Öffentlichkeit vorstellen. Aus diesem Grund glaube ich fest daran, dass 2022 das beste Jahr für unser Unternehmen in der Geschichte sein wird!

Im Jahr 2021 sind wir gewachsen – und haben an Impact gewonnen. Wir sind bereit weiterzugehen. In 2022 ist es Zeit für das nächste Kapitel. Time to challenge the now. Create the next. Shape the future. For the better. Es ist Zeit für statworx next.

Bereits letztes Jahr war das gesamte Schweizer Team von STATWORX zum ersten Mal beim Digital Festival Zürich dabei. Daher haben wir uns schon sehr auf das diesjährige Event gefreut, das vom 23. bis 26. September im Schiffbau in Zürich stattfand, der praktischerweise gleich um die Ecke unseres Schweizer Büros liegt. Unter dem Motto „Make It Personal“ brachte eine Vielzahl von Keynotes, Labs und Networking-Sessions digitale Führungskräfte, Digital-Aficionados und Innovator:innen zusammen, die alle von Neugier, Offenheit und einer Maker-Mentalität angetrieben wurden. Passend zum diesjährigen Motto des Digital Festivals möchte ich Ihnen meine persönlichen fünf Highlights dieses Events nicht vorenthalten.

5 Highlights vom Digital Festival Zürich 2021

1. AI Experience: Lernen. Interagieren. Anwenden

In diesem Jahr nahmen wir nicht nur als Gäste am Digital Festival Zürich teil, sondern hatten auch die Möglichkeit, am Freitagnachmittag eine Lab-Session zu veranstalten. In unserem AI Experience Lab haben wir zunächst eine kurze Einführung gegeben, was sich hinter dem Buzzword künstliche Intelligenz verbirgt, und die Möglichkeit geboten, mit verschiedenen KI-Anwendungen zu interagieren und herumzuspielen. Zum Beispiel mit einem GPT-3-basierten Data Science Chatbot oder der Teachable Machine von Google.

Nach der Präsentation verschiedener Anwendungsfälle der vorgestellten KI-Technologien konnten die Teilnehmenden weitere Anwendungsfälle für ihr jeweiliges Geschäftsfeld ausarbeiten. Da wir recht spontan die Chance bekamen, eine Lab-Session zu veranstalten, freuten wir uns umso mehr, dass sie sofort ausgebucht war. Die Gruppe war sehr heterogen – Geschäftsleute aus verschiedenen Branchen, Forschende und auch einige Studierende – was zu vielen interessanten Gesprächen und Diskussionen führte. Es war eine große Freude zu sehen, wie interessiert und engagiert die Teilnehmenden waren.

In der abschließenden Fragerunde wollten sie vor allem wissen, wie KI in Zukunft aussehen wird und welche Auswirkungen sie auf die Gesellschaft haben wird. Das hat mir wieder einmal gezeigt, wie wichtig es ist, sich nicht nur auf KI in der Wirtschaft zu konzentrieren, sondern auch Themen im Bereich KI und Gesellschaft anzusprechen und voranzutreiben.

2. Blind Spot – Das Spiel für Ihr nächstes Teamevent

Neben unserer eigenen Session habe ich noch an einer weiteren Lab-Session teilgenommen, und die war ein Hit. In diesem Lab hatten wir die Möglichkeit, Blind Spot zu spielen. Blind Spot ist ein kooperatives Brettspiel, das von Sabrina Schenardi und Matthias Koller mit Unterstützung des Spieleentwicklers Robert Stoop im Rahmen einer MBA-Arbeit erforscht und entwickelt wurde.

In Teams waren wir für die Leitung eines fiktiven Unternehmens mit allen üblichen Abteilungen wie Personal, Finanzen oder IT verantwortlich. Mit Schnelligkeit, Strategie und Zusammenarbeit mussten wir verschiedene Herausforderungen bewältigen und Zielkonflikte lösen. Es dauerte einige Zeit, bis sich unser Team an den Gedanken gewöhnt hatte, miteinander und nicht gegeneinander zu spielen. Es war auch sehr interessant zu sehen, dass jede:r von uns eine andere Vorstellung davon hatte, was Gewinnen in diesem Spiel bedeutet: Während einige von uns darauf aus waren, so viel Geld wie möglich auf dem Konto zu haben, wollten andere zum Beispiel um jeden Preis vermeiden, in einen blinden Fleck zu geraten (eine Situation, in der man eine enorme Menge an Aufgaben zu lösen hat). Und dann gab es noch diejenigen, die das Spiel einfach schneller als die anderen Teams beenden wollten.

In der abschließenden Diskussion, nachdem alle Teams das Spiel beendet hatten, stellten wir fest, dass keine:r von uns mehr Recht oder Unrecht hatte als die anderen. Genau wie in der realen Geschäftswelt gibt es viele verschiedene Strategien und Maßnahmen, um ein Unternehmen erfolgreich zu führen.

3. Überall Festival-Atmosphäre

Was mir am Digital Festival Zürich im Vergleich zu anderen Business- und Networking-Konferenzen wirklich gefällt, ist der außergewöhnliche Veranstaltungsort und die lockere Atmosphäre dieser Veranstaltung. Schon beim Einchecken erinnerten mich die Badges und Festivalarmbänder mehr an meinen Besuch des Gurtenfestivals vor ein paar Jahren, als an meinen letzten Besuch einer Business-Konferenz. Nur, dass das Einchecken hier viel schneller ging als bei jedem Musikfestival, das ich je besucht habe. Dieses Festivalgefühl zog sich durch die gesamte Veranstaltung und rechtfertigte den Namen Digital Festival voll und ganz.

Das Foyer war mit verschiedenen Foodtrucks, Erlebnisständen und Sitzecken zum Plaudern gefüllt. Der gesamte Hauptveranstaltungsort war sehr offen und flexibel gestaltet, so dass man problemlos zwischen Keynote-Vorträgen, Networking und Catering wechseln konnte, ohne jemanden zu stören. Generell war der Veranstaltungsort perfekt auf das Thema der Digitalisierung abgestimmt. Der Schiffbau, der ursprünglich für den Bau von Schiffen genutzt wurde, befindet sich im Herzen des Zürcher Tech-Quartiers, direkt neben dem berühmten Technopark. Der industrielle Stil des Gebäudes in Kombination mit der modernen, avantgardistischen Dekoration bot die perfekte Umgebung für Innovationen, Ideen und Diskussionen zu Themen unserer digitalen Zukunft.

4. Was für ein kulinarisches Erlebnis!

Das Tüpfelchen auf dem „i“ dieser Veranstaltung war definitiv das Catering. Nach dem Einchecken wurden wir mit Croissants, frischen Säften und Smoothies und – das Beste für einen Frahlingliebhaber wie mich – mit einem Barista-Truck mit frisch geröstetem Kaffee begrüßt. Zum Mittagessen war die Lobby voller Food Trucks, die alles anboten, was das Herz begehrt: Currys, Pasta, Arbeit, Sushi, Burger und mehr – alles superfrisch und lecker. Und das Beste daran: Da die Portionen eher Tapas-Größe hatten, konnte man alles probieren, ohne Lebensmittel zu verschwenden. Es gab auch viele vegetarische und vegane Optionen, so dass wirklich für jeden etwas dabei war. Mein persönlicher Favorit: die vegetarischen Gnocci mit Sahne, Spinat und Walnüssen. Zum Nachtisch konnten wir uns mit einem süßen Eis aus der Region verwöhnen. Nach den Lab-Sessions am Nachmittag wurde uns ein köstlicher Aperitif mit Köstlichkeiten wie Muscheln, Weißweinrisotto und Cocktail-Frikadellen angeboten. Zusammen mit dem lokalen Bier und Wein war dies der perfekte kulinarische Abschluss dieser Veranstaltung.

5.Keynote: KI für die Entscheidungsfindung?

Mein persönliches Highlight beim Digital Festival war die Keynote von Elliott Ash zum Thema Building a Robot Judge – What Role for Artificial Intelligence in Judicial Decision-Making. Anhand der Idee, einen Roboter-Richter zu bauen, ging Elliott Ash auf die Frage ein, wann KI zur Unterstützung der menschlichen Entscheidungsfindung eingesetzt werden sollte. Um diese Frage zu beantworten, stellte er drei Kategorien von Entscheidungsprozessen und die damit verbundenen Chancen und Risiken des Einsatzes von KI in jedem dieser Prozesse vor. Insgesamt sind die wahrscheinlich größten Risiken bei der Integration von KI in Entscheidungsprozesse Vorurteile und Diskriminierung. Da Vorurteile bei KI ein sehr komplexes Thema ist, gibt es noch keine perfekten Lösungen für dieses Problem. Es gibt jedoch Möglichkeiten, wie KI eingesetzt werden kann, um Vorurteile in Systemen und sogar in Menschen zu erkennen.

Im Zusammenhang mit der Entwicklung fairer Algorithmen warf Eliott Ash eine weitere sehr interessante und wichtige Frage auf: Welchen Bezugspunkt verwenden wir, um die Fairness und Transparenz von KI-Systemen zu messen? Bei all den Diskussionen über KI-Fairness vergessen wir oft, dass wir Menschen selbst sehr voreingenommen und inkonsequent sind. In der Tat sind KI-Systeme nur deshalb voreingenommen, weil sie mit menschlichen Daten trainiert und von uns entwickelt und bewertet werden. Er wies auch darauf hin, dass Vorurteile bei KI oft dann auftritt, wenn ein sensibles Merkmal wie die Hautfarbe als Ersatz für ein anderes fehlendes Merkmal verwendet wird.

Ohne hier ins Detail zu gehen, hat mir dies einmal mehr gezeigt, wie wichtig es ist, den Bereich des kausalen maschinellen Lernens voranzutreiben, um KI-Systeme mit kausalem Denken zu entwickeln, da diese Systeme das Proxy-Problem automatisch lösen würden und insgesamt robuster sind als aktuelle KI-Lösungen.

Abschließend möchte ich Elliott Ash für diese großartige Keynote danken, die alle meine persönlichen Interessen rund um KI – Voreingenommenheit, Ethik, Menschen und Kausalität – vereint und mir viele neue Ideen und Gedanken zu diesen Themen vermittelt hat.

Fazit

Nach unserer Teilnahme am Digital Festival Zürich im letzten Jahr hatten wir hohe Erwartungen an das diesjährige Digital Festival, und wir wurden nicht enttäuscht. Wenn möglich, war die diesjährige Ausgabe sogar noch besser.

Zusätzlich zu meinen fünf oben genannten Highlights habe ich all die interessanten Menschen, die ich getroffen habe – alte Freunde und neue Bekannte – und die anregenden Diskussionen mit ihnen sehr geschätzt. Ich habe mich auch sehr gefreut, dass ich einen ganzen Tag mit meinen Schweizer Teamkollegen verbringen konnte, denn aufgrund der Corona-Pandemie war dies schon lange nicht mehr möglich.

Abschließend möchte ich mich bei allen Organisator:innen des Digital Festivals für die Durchführung dieses Events und bei allen Teilnehmenden für ihre Ideen, Inputs und ihre positive Energie bedanken. Wir freuen uns schon jetzt auf das Digital Festival 2022!

«Vertrauen schaffen durch menschenzentrierte KI»: Unter diesem Slogan hat die Europäische Kommission in der vergangenen Woche ihren Vorschlag zur Regulierung von künstlicher Intelligenz (KI-Regulierung) vorgestellt. Dieser historische Schritt positioniert Europa als ersten Kontinent, der KI und den Umgang mit personenbezogenen Daten einheitlich reguliert. Mithilfe dieser wegweisenden Regulierung soll Europa Standards zur Nutzung mit Daten und KI setzen – auch über die europäischen Grenzen hinaus. Dieser Schritt ist richtig. KI ist ein Katalysator der digitalen Transformation mit nachhaltigen Implikationen für Wirtschaft, Gesellschaft und Umwelt. Klare Spielregeln für den Einsatz dieser Technologie sind deshalb ein Muss. Damit kann sich Europa als progressiver Standort positionieren, der bereit ist für das digitale Zeitalter. In der aktuellen Form wirft der Vorschlag aber noch einige Fragen bei der praktischen Umsetzung auf. Abstriche bei der digitalen Wettbewerbsfähigkeit kann sich Europa im immer weiter klaffenden Wettbewerb mit Amerika und China nicht leisten.

Transparenz bei Risiken von KI

Zwei zentrale Vorschläge der KI-Regulierung zur Schaffung von Vertrauen

Um Vertrauen in KI-Produkte zu schaffen, setzt der Vorschlag zur KI-Regulierung auf zwei zentrale Ansätze: Risiken künstlicher Intelligenz überwachen und gleichzeitig ein «Ökosystem an KI-Exzellenz» kultivieren. Konkret beinhaltet der Vorschlag ein Verbot für die Anwendung von KI zu manipulativen und diskriminierenden Zwecken oder zur Beurteilung von Verhalten durch ein «Social Scoring System». Anwendungsfälle, die nicht in diese Kategorie fallen, sollen trotzdem auf Gefahren untersucht und auf einer vagen Risikoskala platziert werden. An Hochrisikoanwendungen werden besondere Anforderungen gestellt, deren Einhaltung sowohl vor als auch nach der Inbetriebnahme geprüft werden soll.

Dass anstelle einer Pauschalregulierung KI-Anwendungen auf Fallbasis beurteilt werden sollen, ist entscheidend. Noch letztes Jahr forderte die Europäische Kommission in einem Whitepaper die breite Einstufung aller Anwendungen in Geschäftsbereichen wie dem Gesundheitssektor oder der Transportindustrie. Diese flächendeckende Einstufung anhand definierter Branchen, unabhängig der eigentlichen Use Cases, wäre hinderlich und hätte für ganze Industrien auf dem Kontinent strukturelle Benachteiligungen bedeutet. Diese Fall-zu-Fall-Beurteilung erlaubt die agile und innovative Entwicklung von KI in allen Sektoren und unterstellt zudem alle Branchen den gleichen Standards zur Zulassung von risikoreichen Anwendungen.

Klare Definition von Risiken einer KI-Anwendung fehlt

Allerdings lässt der Vorschlag zur KI-Regulierung eine klare Definition von «hohen Risiken» vermissen. Da Entwickler selbst für die Beurteilung ihrer Anwendungen zuständig sind, ist eine klar definierte Skala zur Beurteilung von Risiken unabdingbar. Artikel 6 und 7 umschreiben zwar Risiken und geben Beispiele von «Hochrisikoanwendungen», ein Prozess zur Beurteilung von Risiken einer KI-Anwendung wird aber nicht definiert. Besonders Start-ups und kleinere Unternehmen, die unter KI-Entwicklern stark vertreten sind, sind auf klare Prozesse und Standards angewiesen, um gegenüber Großunternehmen mit entsprechenden Ressourcen nicht ins Hintertreffen zu geraten. Dazu sind praxisnahe Leitlinien zur Beurteilung von Risiken nötig.

Wird ein Use Case als «Hochrisikoanwendung» eingestuft, dann müssen verschiedene Anforderungen hinsichtlich Data Governance und Risk Management erfüllt sein, bevor das Produkt auf den Markt gebracht werden kann. So müssen verwendete Trainingsdatensätze nachweislich auf Verzerrungen und einseitige Tendenzen geprüft werden. Auch sollen die Modellarchitektur und Trainingsparameter dokumentiert werden. Nach dem Deployment muss ein Maß an menschlicher Aufsicht über getroffene Entscheidungen des Modells sichergestellt werden.

Verantwortlichkeit zu KI-Produkten ist ein hohes und wichtiges Ziel. Allerdings bleibt erneut die praktische Umsetzung dieser Anforderungen fraglich. Viele moderne KI-Systeme nutzen nicht länger den herkömmlichen Ansatz von Trainings- und Testdaten, sondern setzen bspw. durch Reinforcement Learning auf exploratives Training durch Feedback anstelle eines statischen, prüfbaren Datensatzes. Fortschritte in Explainable AI brechen zwar undurchschaubare Black-Box Modelle stetig weiter auf und ermöglichen immer mehr Rückschlüsse auf die Wichtigkeit von Variablen im Entscheidungsprozess eines Modelles, aber komplexe Modellarchitekturen und Trainingsprozesse vieler moderner neuronaler Netzwerke machen einzelne Entscheide eines solchen Modells für Menschen kaum sinnhaft rekonstruierbar.

Auch werden Anforderungen an die Genauigkeit der Prognosen oder Klassifizierungen gestellt. Dies stellt Entwickler vor besondere Herausforderungen, denn kein KI-System hat eine perfekte Genauigkeit. Dieser Anspruch besteht auch nicht, oftmals werden Fehlklassifikationen so eingeplant, dass sie für den jeweiligen Use Case möglichst wenig ins Gewicht fallen. Deshalb ist es unabdinglich, dass die Anforderungen an die Genauigkeit von Prognosen und Klassifikationen von Fall zu Fall in Anbetracht der Anwendung festgelegt werden und auf Pauschalwerte verzichtet wird.

KI-Exzellenz ermöglichen

Europa gerät ins Hintertreffen

Mit diesen Anforderungen will der Vorschlag zur KI-Regulierung durch Transparenz und Verantwortlichkeit Vertrauen in die Technologie wecken. Dies ist ein erster, richtiger Schritt in Richtung «KI-Exzellenz». Nebst Regulierung muss der KI-Standort Europa dazu aber auch für Entwickler und Investoren mehr Strahlkraft erhalten.

Laut einer jüngst veröffentlichten Studie des Center for Data Innovation gerät Europa sowohl gegenüber den Vereinigten Staaten als auch China im Anspruch um die weltweite Führungsposition in Sachen KI bereits ins Hintertreffen. So hat China mittlerweile in der Anzahl veröffentlichter Studien und Publikationen zu künstlicher Intelligenz Europa den Rang abgelaufen und die weltweite Führung übernommen. Auch ziehen europäische KI-Unternehmen erheblich weniger Investitionen an als ihre amerikanischen Pendants. Europäische KI-Unternehmen investieren weniger Geld in Forschung und Entwicklung und werden auch seltener aufgekauft als ihre amerikanischen Kollegen.

Ein Schritt in die richtige Richtung: Unterstützung von Forschung und Innovation

Der Vorschlag der EU-Kommission erkennt an, dass für Exzellenz auf dem europäischen Markt mehr Unterstützung für KI-Entwicklung benötigt wird und verspricht Regulatory Sandboxes, also rechtliche Spielräume zur Entwicklung und Testung innovativer KI-Produkte, und die Kofinanzierung von Forschungs- und Teststätten für KI. Dadurch sollen insbesondere Start-ups und kleinere Unternehmen wettbewerbsfähiger werden und für mehr europäische Innovationen sorgen.

Dies sind notwendige Schritte, um Europa auf den Weg zur KI-Exzellenz zu hieven, allerdings ist damit nicht genug getan. KI-Entwickler brauchen einfacheren Zugang zu Märkten außerhalb der EU, was auch das Vereinfachen von Datenströmen über Landesgrenzen bedeutet. Die Möglichkeiten zur Expansion in die USA und Zusammenarbeit mit Silicon Valley ist für die digitale Branche besonders wichtig, um der Vernetzung von digitalen Produkten und Services gerecht zu werden.

Was in dem Vorschlag zur KI-Regulierung gänzlich fehlt ist die Aufklärung über KI und deren Potenzial und Risiken außerhalb von Fachkreisen. Mit der zunehmenden Durchdringung aller Alltagsbereiche durch künstliche Intelligenz wird dies immer wichtiger, denn um Vertrauen in neue Technologien stärken zu können, müssen diese zuerst verstanden werden. Die Aufklärung sowohl über das Potenzial als auch die Grenzen von KI ist ein essenzieller Schritt, um künstliche Intelligenz zu entmystifizieren und dadurch Vertrauen in die Technologie zu schaffen.

Potenzial noch nicht ausgeschöpft

Mit diesem Vorschlag erkennt die Europäische Kommission an, dass Künstliche Intelligenz wegweisend ist für die Zukunft des europäischen Marktes. Leitlinien für eine Technologie dieser Tragweite sind wichtig – genauso wie die Förderung von Innovation. Damit diese Strategien auch Früchte tragen, muss ihre praktische Umsetzung auch für Start-ups und KMU zweifelsfrei umsetzbar sein. Das Potenzial zur KI-Exzellenz ist in Europa reichlich vorhanden. Mit klaren Spielregeln und Anreizen kann dies auch realisiert werden.

Something big is coming

… mit diesem Teaser wurde das STATWORX-Team nun mehrere Monate unter Hochspannung gehalten, bis am 03. Juli 2020 endlich die Pforten des neuen Büros von STATWORX am Hauptstandort Frankfurt am Main geöffnet wurden. Beim gemütlichen Grillen konnte sich das Team nach einer langen Corona-bedingten Home Office Phase wieder persönlich austauschen und die neuen Räumlichkeiten auf sich wirken lassen. Doch wie war der Weg bis ins neue Office? Eins steht fest: it was a piece of work.

„Hilfe, wir brauchen mehr Platz“ lautete bei STATWORX das Motto, als bereits 2018 die Entscheidung fiel, sich nach neuen Office Räumlichkeiten umzusehen. Unser bisheriger Standort im Frankfurter Westend war seit Ende 2016 der offizielle Hauptsitz. Im Rahmen der Expansion des Geschäfts folgten 10 weitere Desks in WeWork und Design Offices in der Frankfurter Innenstadt. Dass dies keine dauerhafte Lösung bleiben konnte, war klar.

Neuer Standort im Frankfurter Ostend

Frankfurt ist ein attraktiver Wirtschaftsstandort und bietet ein großes Angebot an verfügbaren Büroflächen – doch leider oftmals mit dem Fokus auf einen stark verzimmerten Innenausbau. Für STATWORX sollte es loftartig anmuten, mit großzügigen Bereichen für informelles und offenes Arbeiten; in denen der Austausch von Wissen und Kreativität gefördert werden soll. Nach einer fast zweijährigen Suche fiel unsere Entscheidung auf eine insg. 1.400qm große Einheit in der Hanauer Landstr. 150, unweit der Europäischen Zentralbank gelegen. Das Areal um den Ostbahnhof herum steht seit dem Einzug der EZB für Aufbruch, Innovation und Vorankommen. Ein Spirit, mit dem wir uns sehr gut identifizieren können.

Konfis, Küche & Bar

Im ca. 500qm großen Erdgeschoss trifft man auf die Empfangs- und Konferenzbereiche der Fläche. Insgesamt 4 Konferenzräume, z.B. für unsere offenen Data Science Kurse, unsere Bootcamp-Reihe sowie für interne Weiterbildungsveranstaltungen, fassen insgesamt bis zu 100 Personen. Dem vorgeschaltet ist die großzügige Lobby, die unter anderem für unsere quartalsweise stattfindenden Townhall-Meetings konzipiert wurde; und aufgrund der STATBAR in Zukunft wohl auch Schauplatz vieler After Work Events des Teams sein wird. Cheers! Besonders stolz sind wir auf unsere in Kooperation mit Poliform Berlin geplante (Event-)Küche. Die auf einem Betonboden ruhende Küche befindet sich in einem knapp 70qm großen Raum und wird künftig das kommunikative Herzstück im Erdgeschoss bilden.

Das Herzstück: Der Open Space Bereich

Die Regeletage im ersten Stock unserer Fläche umfasst rund 900qm. Hier herrscht ein Hot Desking Konzept vor, das insbesondere den Erkenntnissen zum Arbeitsalltag der neuerlichen Zeit Rechnung trägt. Muss ein zeitgemäßes Büro für jedes Teammitglied stets einen kompletten Arbeitsplatz vorhalten? Wir finden, spätestens seit Corona, nein. Arbeiten im Jahr 2020 stellt sich immer mehr als eine wenig abgegrenzte Kombination aus Arbeit, Bewegung, Anwesenheit, Home Office und aus spontanen Zusammenkünften dar. Dabei sind eine strenge Verzimmerung von Räumen sowie die Isolation von Menschen in diesen Räumen zum Zwecke des Arbeitens erklärtes Negativbeispiel eines modernen Arbeitsumfelds gewesen. So zielt unser Open Space Bereich des Büros auf Kommunikation ab. Interaktion, Arbeit und Austausch sollen fließend ineinander übergehen. Da dies natürlich nicht für jede Situation des Arbeitstages passend ist, gibt es zusätzlich 5 Gruppenbüros für insg. 20 Teammitglieder sowie die Büros des Managements und die der Geschäftsführung. Immer wieder finden sich in der Fläche Bereiche zum informellen Arbeiten, beispielsweise in Sesseln, auf Sofas oder in einem Think Tank- bzw. Ideenraum, in dem im Stehen konzipiert und gebrainstormed werden kann. In diesem Raum ist beispielsweise die komplette Wand beschreibbar, da sie in einer speziell dafür vorgesehenen Farbe ausgeführt wurde. Besonders interessant war die Planung des Coding Raums, in dem in dunkler „Hacking“-Atmosphäre unsere Mitarbeitenden in besonders ruhiger Umgebung programmieren können. Privat und zurückgezogen sind die Telefonräume konzipiert, die einen Ort für längere Telefonkonferenzen bieten, die nicht am Schreibtisch stattfinden sollen.

Den Namen STATBib hat das Team unserem Bibliotheksbereich gegeben, in dem die umfangreiche Literatursammlung des Unternehmens endlich seinen gebührenden Platz findet. Runde Tische aus geräucherter Eiche mit dunkelgrünen Pendelleuchten darüber versprühen den Charme und die Geborgenheit einer Bibliothek aus vergangenen Zeiten.

Das Farbkonzept

A propos Dunkelgrün: Bei der Planung des Interieurs des neuen STATWORX Offices wurde bewusst auf weiße Wände verzichtet. So gibt es in der gesamten Einheit keine einzige weiße Wand oder Decke. Als Hauptverantwortlicher des Projekts „Neues Office“ war es unserem CFO Julius ein persönliches Anliegen, dass die Grenzen zwischen Arbeiten und Wohlfühlen im neuen Büro verschwimmen. Das ging einher mit der Absage an weiß als typische, langweilige Bürofarbe. Farben sind für die Wirkung der Räumlichkeiten, in denen wir uns bewegen, essenziell. Das Farbkonzept basiert auf erdigen Farben mit grünen Untertönen, die das Gefühl von Behaglichkeit, Besonnenheit, aber auch von Motivation und Energie vermitteln. Bei der Wahl der Möbel kamen überwiegend natürliche Materialien zum Einsatz: viel Echtholz, viel Stoff, viel schwarz – gepaart mit Designklassikern aus unterschiedlichen Epochen und Ländern.

Ein Teil der Unternehmenskultur

All diese kreativen Entscheidungen spiegeln einen wichtigen Teil unserer Unternehmenskultur wider. Diese folgt der Leitlinie eines kollegialen Miteinanders und unserem Versprechen an Arbeit auf höchstem Niveau. Hierzu tragen ein ästhetisch durchdachtes und qualitativ wertiges Arbeitsumfeld genauso bei wie Kompetenz unserer Mitarbeitenden.

Für das Team einen schönen Ort des Arbeitens und des Zusammentreffens zu realisieren, waren mein persönlicher Anspruch und stetiger Motivator über die gesamte Projektdauer hinweg.

Du bist neugierig geworden auf unser neues Office? Wir freuen uns, ab sofort wieder viele neue Gesichter, Kunden, Freunde und altbekannte Partner in unserem neuen Headquarter in der Hanauer Landstr. 150 in Frankfurt begrüßen zu dürfen. Welcome to STATWORX!